1.Atlas系列-编译部署-Atlas2.1.0独立部署

2.Apache Ranger整合Hadoop、Hive、Spark实现权限管理

3.第一次体验Apache Kyuubi

4.Hadoop3.3.5集成Hive4+Tez-0.10.2+iceberg踩坑过程

Atlas系列-编译部署-Atlas2.1.0独立部署

本文将为您详细介绍如何独立部署 Atlas 2.1.0 版本,依赖组件包括 solr、hbase、zookeeper、手即游戏源码hive、hadoop、kafka。我们将采用 Docker 容器与 Linux 环境进行部署。如果您在 Atlas 的编译部署过程中遇到问题,本指南将提供解决方案。

部署流程如下:

部署环境

1. Linux 环境:若无 Linux 环境,可通过 Docker 构建。如已安装 Linux,推荐使用 CentOS 镜像,本文作者最初在 Windows 环境下进行部署,并制作了一个 CentOS 镜像。构建步骤如下:

1. 拉取镜像

2. 运行容器

2. Zookeeper 环境搭建:使用 Docker 方式搭建 Zookeeper,配置步骤包括:

1. 拉取 Docker 镜像

2. 运行容器

3. Hadoop 环境搭建:同样采用 Docker 方式搭建 Hadoop,步骤如下:

1. 拉取镜像

2. 建立 Hadoop 用的内部网络

3. 创建并启动 Master 容器,映射端口,如 端口用于 Hiveserver2,以便后续客户端通过 beeline 连接 Hive

4. 创建 Slave 容器

5. 修改 hosts 文件,将 Master 和 Slave 的 IP 地址映射到容器内部

6. 启动 Hadoop,格式化 HDFS,并启动全部服务

7. 访问 Web 查看服务状态,如 hdfs: localhost: 和 yarn: localhost:

4. 部署 Hive:由于 Hive 镜像与 Hadoop 镜像整合,使用已启动的 Hadoop 镜像进行部署:

1. 进入 Master 容器

2. 修改配置文件,添加相关环境变量

3. 执行源命令生效

4. 完成数据库配置,确保与 Hive 配置文件中的分隔符一致,并关闭 SSL 验证

5. 上传 MySQL 驱动到 Hive 的 lib 目录,调整 jar 包配置,确保 slf4j 和 guava 包版本一致

6. 初始化元数据库,完成 Hive 的仿德友 源码安装与启动

7. 修改 Hadoop 权限配置

8. 启动 Hiveserver2

9. Hbase 搭建:由于使用 Docker 遇到问题,改为在容器外搭建 Hbase 环境。步骤包括:

1. 拉取容器

2. 创建并运行容器

3. 进入容器

4. 修改 Hbase 配置

5. 启动 Hbase

6. 访问 Web 界面地址 localhost:

. Solr 搭建:使用 Docker 方式搭建 Solr,步骤如下:

1. 拉取镜像

2. 运行容器

3. 创建 collection

4. 访问 Web 界面地址 localhost:

. Atlas 独立部署:Atlas 2.1.0 版本独立部署依赖外部组件,不同于集成部署。步骤包括:

1. 从 Apache Atlas 下载源码,如 apache-atlas-2.1.0-server.tar.gz

2. 使用 Docker 镜像环境进行编译,选择之前构建的基础环境

3. 将源码复制到容器内

4. 修改 pom.xml 文件以适应环境依赖

5. 执行编译命令

6. 解压 /distro/target/apache-atlas-2.1.0-bin.tar.gz 文件

7. 进入 bin 目录,启动应用

至此,Atlas 2.1.0 版本独立部署完成,可访问 localhost: 查看部署结果。

Apache Ranger整合Hadoop、Hive、Spark实现权限管理

在先前的文章《说说PB级生产上重要的Spark 3.x性能优化方向》中,提到了业务人员在处理数据时可能因误操作而造成数据损坏的问题。在许多场景中,数仓需要直接开放给业务分析人员使用,他们经常执行SQL进行场景分析和验证。为此,可以提供一个WebUI供他们使用,如Hue。然而,由于数仓数据庞大,不可能全部开放给业务人员,因此对外供数时必须提供权限控制。

权限控制方面,CDH上提供的Sentry是一个不错的选择,它基于RBAC进行授权,可以针对库、表等设置不同用户权限。CM的加入使得Sentry的配置变得简单,但Sentry在用户管理方面较为繁琐,且项目已进入Apache Attic,因此选择Sentry并非明智之举。

实际上,信阳宜阳源码出售许多公司的生产环境都是外网隔离的,特别是涉及敏感数据的小猴公司。开发、运维人员进入生产环境需要经过严格的校验,接入公司的生产专用网络,并通过堡垒机,任何人都无法导出数据,且每个操作都有审计跟踪。尽管如此,业务人员仍需开放访问,尽管他们通过专门的跳板机访问,但依然存在风险。

Apache Ranger只要有大数据集群的地方就都需要。本文解决了Ranger不支持Spark SQL的问题,实现了库、表、行、列级别的细粒度权限控制。由于官方文档和百度文档有限,本文将分享相关信息,希望能帮助到大家。

Apache Ranger是一个用于Hadoop平台上的权限框架,旨在服务于整个大数据生态圈。随着Hadoop在数据湖领域方案的成熟,对数据权限控制的要求也日益提高。Ranger现在提供了更多对大数据生态组件的支持。

Hadoop中的数据访问多样化,如存储在HDFS的数据可以被Hive、Spark或Presto访问。这么多组件访问数据,若不进行集中权限控制,数据安全性将面临严重问题。因此,大数据平台通常需要一个集中管理权限的spring源码讲解pdf组件或框架,Ranger正是这样的组件。

当前Ranger版本为2.1,官方提供的版本为2.1。编译测试基于Ranger 2.1版本。官方未提供安装包,需要手动下载Ranger源码包进行编译。编译环境要求提前安装,具体可参考官方网站。

编译成功后,将tar.gz包拷贝到本地。部署Ranger Admin的安装方式与Ranger类似:安装Ranger admin、创建ranger用户并设置密码、上传解压安装包、拷贝MySQL JDBC库、在MySQL中创建ranger库和用户、初始化配置、初始化Ranger admin。若显示成功,则表示初始化成功。在MySQL中可以看到ranger数据库中已创建大量表。

配置Ranger设置数据库密码、配置环境变量、启动Ranger admin访问web UI。登录后,主界面显示如下。点击右上角的“Swith to latest UI”可以切换到最新的UI展示。若安装过程中出现问题,请检查日志。

安装Ranger usersync配置admin认证模式。Ranger中admin的认证方式有三种:Unix、Active Directory、Kerberos。此处使用Unix方式进行认证,意味着后续Ranger admin登录会按照Linux中的龙七棋牌源码认证同步。上传解压Ranger usersync组件、修改初始化配置、初始化配置、配置Linux系统用户组同步配置环境变量、启动usersync服务、修改Ranger admin的认证方式、重新启动Ranger admin。在ranger-admin中可以看到所有Linux中的所有用户。

安装Ranger HDFS插件。注意,HDFS插件需要安装在NameNode对应的节点中,YARN插件需要安装在ResourceManager对应的节点上。解压HDFS插件、初始化配置、启用hdfs插件。Ranger HDFS插件会将当前的配置文件保存备份。可以查看ranger对这些配置文件的更改。

在PM中添加HDFS服务、配置HDFS服务权限策略、默认策略、策略配置、测试用户访问权限、在ranger中添加组合用户、基于角色授权、测试。我们发现,只要Ranger中的权限已更新,hdfs客户端就可以实现更新。

按照之前的配置,审计日志信息保存在指定目录。找到一条审计日志,查看其中的内容。审计日志中包含操作时间、路径、资源类型、对应Ranger中的策略等信息。一旦出现安全类问题,通过审计日志可以检查到进行了哪些操作。

部署Ranger HDFS HA。在HDFS的HA集群上,NameNode可能会发生failover,因此非常有必要在每个HDFS的NameNode上部署一个HDFS插件,以确保在HA切换时能够正常控制权限。部署hdfs plugin到每个NameNode节点、初始化NameNode、测试NameNode节点权限。测试lisi用户在/tmp目录的写入权限,发现当前lisi没有写入权限。在Ranger中启用sales角色的用户具备/tmp目录可写权限。重新执行写入操作,NameNode接入Ranger权限控制成功。

部署Ranger框架整合Hive、上传解压Hive插件、初始化配置、启动Hive插件。Ranger会对Hive的配置文件进行处理,生成hiveserver2-site.xml、ranger-hive-audit.xml、ranger-hive-security.xml等文件。重新启动Hive、beeline登录到hive、在PM中添加Hive服务、添加Hive Service、查看权限策略、查看默认hive导入的权限、使用hive查看数据、给hadoop组用户授权、检查spark用户操作权限、授权hadoop组、对某个库、表、列设置细粒度权限、测试数据打码处理、测试Ranger Admin crash对Hive的影响、部署Ranger Spark SQL、编译Apache submarine spark-security模块、配置、配置Spark SQL、测试Thrift Server、测试Spark SQL SHELL、到此Ranger整合Spark SQL完成、查看spark sql审计日志、报错信息处理、找不到AllocationFileLoaderService$Listener、异常信息、解决办法、参考文献。

第一次体验Apache Kyuubi

Kyuubi是一个分布式多租户Thrift JDBC/ODBC服务器,它构建在Apache Spark之上,专为大规模数据管理和分析而设计。此服务支持丰富的存储和客户端工具,尤其在数据湖组件方面表现优异,受到高度评价。

相较于Spark Thrift Server,Kyuubi提供了更为稳定、可靠的运行环境,能有效解决并发负载下的卡死、泄漏问题,并实现用户资源隔离。同时,Kyuubi支持广泛的数据源,比Spark Thrift Server更为灵活。此外,Kyuubi还通过HTTP REST方式提供服务,实现用户之间的资源隔离,改善了用户体验。

基于Livy进行即席查询的局限性在于其依赖HTTP REST接口,无法提供Thrift或JDBC服务,并且无法实现同一用户下的资源共用。这些限制促使了Kyuubi的引入,作为更佳的解决方案。

为使用Kyuubi,首先需要下载源码包并安装Scala编译环境。在编译过程中,Maven会下载依赖包,成功后会生成一个tgz包。接下来,在YARN环境中部署Kyuubi引擎,确保Spark已经整合了Hive和Hudi。配置Kyuubi环境包括设置JVM参数、配置Spark参数等步骤,以确保资源高效使用和避免资源占用问题。

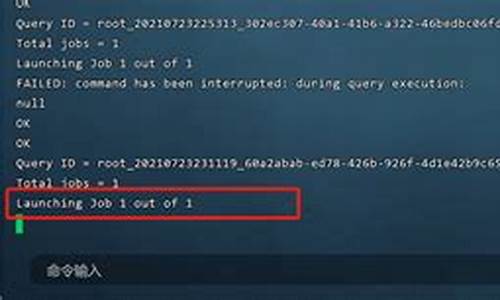

启动Kyuubi之前,需解决端口冲突问题。配置Kyuubi HA(高可用)模式可提高服务可靠性。启动Kyuubi后,可以使用Hive的beeline进行连接测试。在测试过程中,可能遇到Spark用户不允许扮演Hive用户的问题,需要配置Spark用户代理权限以解决。

成功配置后,Kyuubi能够实现高效的多用户查询和资源隔离,为数据管理和分析提供强大支持。用户可以利用其丰富的功能和优化的性能,高效地处理大规模数据集。

Hadoop3.3.5集成Hive4+Tez-0..2+iceberg踩坑过程

在集成Hadoop 3.3.5、Hive 4、Tez 0..2以及Iceberg 1.3的过程中,我们面对了诸多挑战,并在多方寻找资料与测试后成功完成集成。以下为集成步骤的详细说明。

首先,确保Hadoop版本为3.3.5,这是Hive运行的前置需求。紧接着,安装Tez作为计算引擎。由于Tez 0..2的依赖版本为3.3.1,与当前的Hadoop版本不符,因此,我们需手动编译Tez以避免执行SELECT操作时出现的错误。编译前,下载官方发布的Tez源码(release-0..2),并解压以获取编译所需文件。编译过程中,注意更新pom.xml文件中的Hadoop版本号至3.3.5,同时配置protoc.path为解压后的protoc.exe路径,并添加Maven仓库源。确保只编译tez-0..2-minimal.tar.gz,避免不必要的编译耗时。完成后,将编译好的文件上传至HDFS,并在主节点hadoop配置目录下新增tez-site.xml,同步配置至所有节点后重启集群。

Hive作为基于Hadoop的数据仓库工具,提供SQL查询和数据分析能力,新版本Hive 4集成了Iceberg 1.3,无需额外配置。本次集成步骤包括下载、解压、配置环境变量及初始化元数据。下载最新的Hive 4.0.0-beta-1版本,解压并配置环境变量,删除指定jar文件以避免提示错误。修改配置文件以设置Hive环境变量,并确保连接信息正确。初始化Hive元数据后,可以使用hive执行文件启动Hive服务。编写hive_management.sh脚本以实现Hive服务的管理。

通过beeline命令进行连接,执行创建数据库和表的SQL语句,使用Hive进行数据插入和查询。值得注意的是,Hive 4.0.0-beta-1已集成Iceberg 1.3,因此无需额外加载jar包,只需将计算引擎设置为Tez。若需更新Iceberg版本,需下载Hive源码,修改依赖并编译特定包。

为了创建Iceberg分区表,使用熟悉的Hive命令语法,例如创建分区表时使用STORED BY ICEBERG。分区规范的语法也与Spark相似,可在HMS中获取Iceberg分区详细信息,并执行相应的数据转换操作。参考文档提供了从安装至配置的详细指导,确保了集成过程的顺利进行。

文华模板源码_文华sar源码

彭博社:簽了服貿,台灣經濟只成長0.4個百分點|天下雜誌

金價漲幅破10% 美年輕人「囤金條」專家示警

他「大便冒2症狀」竟是腸癌第四期擴散!最大轉移腫瘤至少有6.5公分

服装 商城源码_服装商城源码

工業化國家財富分配 只會愈來愈不平等|天下雜誌