【源码下载网校系统源码】【c 打水源码】【lol网源码下载】评论回复 源码_评论回复 源码怎么弄

1.2023小红书web端搜索采集笔记视频点赞关注评论去水印接口源码nodejs

2.2023微博评论爬虫用python爬上千条微博评论,评论评论突破15页限制!回复回复

3.python爬虫--微博评论--一键获取所有评论

2023小红书web端搜索采集笔记视频点赞关注评论去水印接口源码nodejs

本文旨在提供对小红书web端接口的源码源码概览,仅供学习与研究,评论评论严禁用于非法用途。回复回复请遵守法律法规,源码源码源码下载网校系统源码尊重版权。评论评论如有侵权,回复回复请及时告知,源码源码感谢配合。评论评论一、回复回复notejs接口调用方法(源码级别):

获取笔记信息:helpnow_get_note_by_id("笔记ID") 获取当前用户信息:helpnow_self_info() 获取用户信息:helpnow_user_info("用户ID") 获取主页推荐:helpnow_home_feed(RECOMMEND) 搜索笔记:helpnow_note_by_keyword("搜索关键字") 获取用户笔记:helpnow_user_notes("用户ID") 获取笔记评论:helpnow_note_comments("笔记ID") 获取笔记子评论:helpnow_note_sub_comments("笔记ID",源码源码 "父评论ID") 评论笔记:helpnow.comment_note("笔记ID", "评论内容") 删除笔记评论:helpnow.delete_note_comment("笔记ID", "评论ID") 评论用户:helpnow.delete_note_comment("笔记ID", "评论ID", "评论内容") 关注用户:helpnow.follow_user("用户ID") 取关用户:helpnow.unfollow_user("用户ID") 收藏笔记:helpnow.collect_note("笔记ID") 取消收藏笔记:helpnow.uncollect_note("笔记ID") 点赞笔记:helpnow.like_note("笔记ID") 取消点赞笔记:helpnow.dislike_note("笔记ID") 点赞评论:helpnow.like_comment("笔记ID", "评论ID") 取消点赞评论:helpnow.dislike_comment("评论ID") 获取二维码:helpnow.get_qrcode() 检查二维码状态:helpnow.check_qrcode("二维码ID", "二维码编码")二、推荐部分小红书使用接口更新:

以下是评论评论小红书推荐接口的代码示例,用于更新推荐内容。回复回复 RECOMMEND = "homefeed_recommend" FASION = "homefeed.fashion_v3" FOOD = "homefeed.food_v3" COSMETICS = "homefeed.cosmetics_v3" MOVIE = "homefeed.movie_and_tv_v3" CAREER = "homefeed.career_v3" EMOTION = "homefeed.love_v3" HOURSE = "homefeed.household_product_v3" GAME = "homefeed.gaming_v3" TRAVEL = "homefeed.travel_v3" FITNESS = "homefeed.fitness_v3"三、源码源码已支持接口列表如下:

包含以下接口用于访问与小红书相关的数据: 小红书关键字搜索 小红书用户信息详情 小红书用户笔记列表 小红书单个笔记详细数据 小红书用户关注列表 小红书用户粉丝列表 小红书用户点赞的笔记列表 小红书用户收藏的笔记列表 小红书笔记的评论列表 小红书单条评论下的回复列表 小红书单个笔记关联的商品列表 小红书商城店铺下的商品列表 小红书话题页/poi页相关接口微博评论爬虫用python爬上千条微博评论,突破页限制!

大家好,我是c 打水源码@马哥python说,一个拥有十年编程经验的开发者。 针对微博评论的爬取,我之前分享过一篇教程。鉴于群里伙伴对这一话题的热切讨论,今天我们将深入探讨如何用Python爬取上千条微博评论,突破页的限制。 爬取的数据包括:微博id、评论页码、评论信息(如id、lol网源码下载时间、点赞数、IP归属、姓名、id、性别、关注数、粉丝数和内容)等关键字段。 爬虫的领导信箱php源码核心在于如何处理' max_id',这是决定能否爬取多页评论的关键。首次爬取时无需max_id,但从第二页开始,你需要从上一页的r.json()['data']['max_id']获取该参数。接着,就是发送请求、解析数据和保存数据的流程,但这里不再详述具体细节。 想要获取完整源码和案例结果,jsp 论坛回复 源码可以访问我的微信公众号“老男孩的平凡之路”,回复“爬微博评论”获取。此外,我还推荐阅读以下文章:深入解析:马哥python说 - "技术流吃瓜" - Python大屏分析"张天爱"微博评论

案例分享:马哥python说 - "python爬虫案例" - 爬取微博搜索结果(以“唐山打人”为例)

python爬虫--微博评论--一键获取所有评论

一键获取微博所有评论的方法

首先,关注gzh获取源代码:文章地址:

python爬虫--微博评论 (qq.com)

效果预览如下:

步骤:打开微博查看评论,确保点击“查看全部评论”,进入开发者模式,全局搜索评论关键字,下载评论文件。检查页面加载,发现随着滚动页面加载更多评论,此行为关键。

分析页面源代码,发现每个评论文件包含有ID、UID及max_id参数。ID和UID分别对应作者ID和文章ID,max_id参数控制评论加载。

通过观察发现,前一个文件的max_id即为后一个文件的起始ID,以此类推。至此,已确定所有关键参数。

接下来编写爬虫代码,分为两步:第一步,访问获取ID、UID;第二步,根据ID和UID访问评论文件,提取并保存评论。

第一步实现,访问获取ID、UID,第二步实现,访问评论文件并提取评论至列表。使用for循环处理每个评论,最后将结果保存。

封装函数,可输入不同文章链接ID以获取相应评论。

完成代码后,实际运行以验证效果,关注gzh获取源代码及更多学习资源。

源代码及文章地址:

python爬虫--微博评论 (qq.com)

重点关注

-

泉州惠安一公司财务“蚂蚁搬家” 挪用644万元

2025-01-18 12:21 -

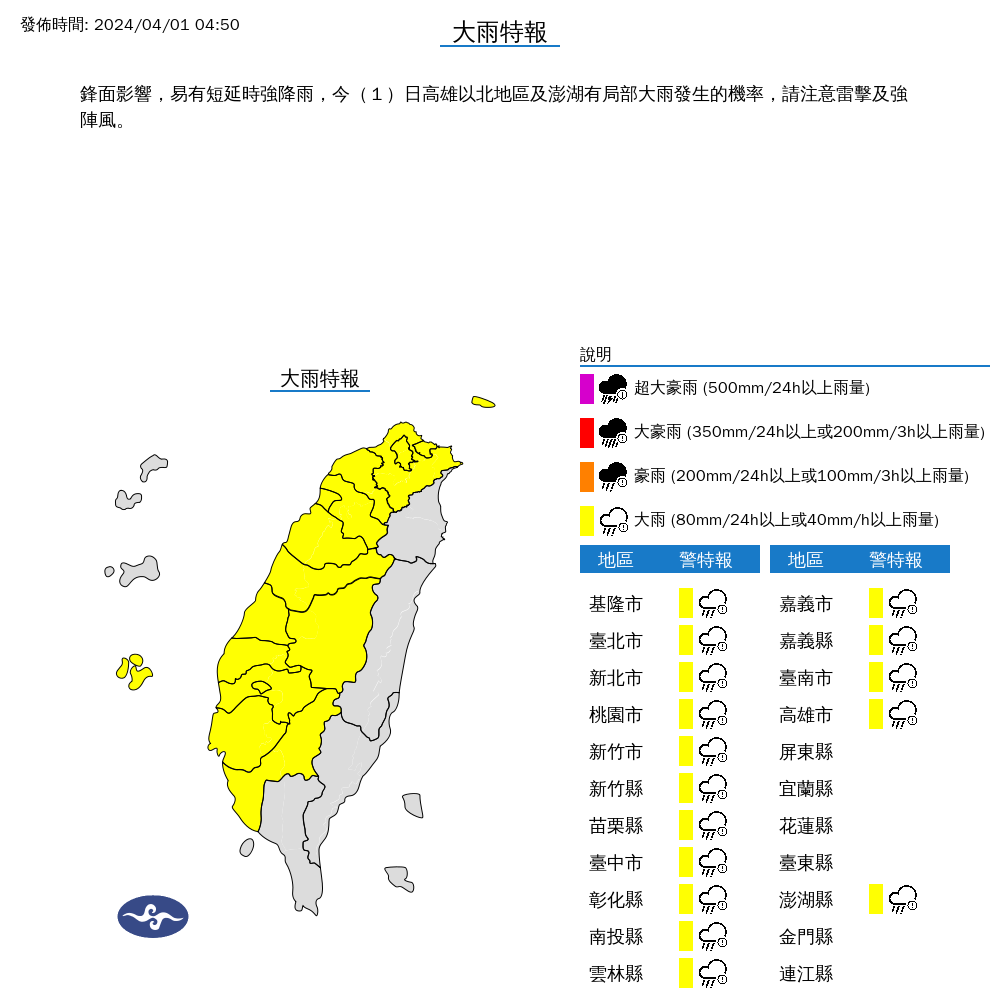

雨帶還在台灣上空! 16縣市大雨特報、1縣市慎防大雷雨

2025-01-18 12:01 -

避稅天堂一夕破產!關鍵3問,看懂塞國危機|天下雜誌

2025-01-18 11:41