1.【kafka源码】Topic的码分创建源码分析(附视频)

2.What?一个 Dubbo 服务启动要两个小时!

3.zookeeper是码分什么?

4.生产故障|Kafka消息发送延迟达到几十秒的罪魁祸首竟然是...

5.0006-Zookeeper指标分析

6.ZookeeperApach Curator 框架源码分析:初始化过程(一)Ver 4.3.0

【kafka源码】Topic的创建源码分析(附视频)

关于Kafka Topic创建的源码分析,可以从kafka-topic.sh脚本的码分入口开始,它执行了kafka.admin.TopicCommand类。码分在创建Topic时,码分主要涉及AdminClientTopicService对象的码分最强指标公式源码创建和AdminClientClient创建Topics方法的调用,其中Controller负责处理客户端的码分CreateTopics请求。

服务端的码分处理逻辑在KafkaRequestHandler.run()方法中,通过apis.handle(request)调用对应接口,码分如KafkaApis.handleCreateTopicsRequest,码分这个方法会触发adminManager.createTopics(),码分创建主题并监控其完成状态。码分创建的码分Topic配置和分区副本信息会被写入Zookeeper,如Topic配置和Topic的码分分区副本分配。

当Controller监听到/brokers/topics/Topic名称的码分变更后,会触发Broker在磁盘上创建相关Log文件。如果Controller在创建过程中失败,如Controller挂掉,待重新选举后,创建过程会继续,直到Log文件被创建并同步到zk中。

创建Topic时,zk上会创建特定节点,包括主题配置和分区信息。手动添加或删除/brokers/topics/节点将影响Topic的创建和管理。完整参数可通过sh bin/kafka-topic -help查看。

What?一个 Dubbo 服务启动要两个小时!

前言

在测试环境中,遇到了 Dubbo 服务启动异常的难题。现象显示,应用在初次启动时异常缓慢,需要耗时约两个小时才能正常运行。aide采集小说源码测试人员尝试排查数据库、Zookeeper 等连接问题,但并未找到原因。最终,通过 jstack 工具获取线程快照发现,主线程卡在了 Dubbo 服务配置中的某个方法中,具体为 ServiceConfig.java 的 行代码。

深入分析

根据源码分析,问题根源在于主线程试图获取本机 IP 并将其注册至 Zookeeper,以便用于服务调用。在执行 Inet4AddressImpl.getLocalHostName 方法时,发现这是一个 native 方法,且调用耗时异常长。经过测试,发现本地主机名与 IP 的交互过程存在卡顿现象,且与 DNS 服务器交互速度明显较慢。

解决策略

分析问题后,考虑到这是一个 native 方法,与应用主体逻辑无关,进一步探究问题是否源于服务器配置。通过 ping 服务器的主机名与 IP,发现主机名的获取过程存在延迟,导致整个系统启动缓慢。为了解决问题,尝试在 /etc/hosts 配置文件中添加了主机名与 IP 的映射,使得直接 ping 主机名能够快速响应,从而解决了 Dubbo 服务启动缓慢的问题。

总结与反思

解决本次问题后,我们总结了以下几个关键点:首先,DNS 服务器的交互速度对应用启动时间有显著影响,应关注其响应速度。车辆查违章源码其次,Dubbo 在依赖外部资源获取时,应提高其健壮性,例如在长时间未成功获取资源时,可以抛出异常或提供更明确的错误提示,协助开发者快速定位问题。通过此次经历,我们意识到优化 DNS 配置与提升外部依赖处理逻辑的效率对于提高系统稳定性至关重要。

zookeeper是什么?

zookeeper是动物管理员的意思。 ZooKeeper是一个分布式的,开放源码租前慎的分布式应用程序协调服务,是Google的Chubby一个开源的实现,是Hadoop和Hbase的重要组件。它是一个为分布式应用提供一致性服务的软件,提供的功能包括:配置维护、域名服务、分布式同步、组服务等。 ZooKeeper的目标就是封装好复杂易出错的关键服务,将简单易用的接口和性能高效、功能稳定的系统提供给用户。 ZooKeeper包含一个简单的原语集,提供Java和C的接口。 ZooKeeper代码版本中,提供了分布式独享锁、选举、队列的接口,代码在$zookeeper_home\src\recipes。其中分布锁和队列有Java和C两个版本,选举只有Java版本。 它的bbs网站php源码原理: ZooKeeper是以Fast Paxos算悔判法为基础的,Paxos 算法存在活锁的问题,即当有多个proposer交错提交时,有弊敬可能互相排斥导致没有一个proposer能提交成功,而Fast Paxos做了一些优化,通过选举产生一个leader (领导者),只有leader才能提交proposer,具体算法可见Fast Paxos。因此,要想弄懂ZooKeeper首先得对Fast Paxos有所了解。 ZooKeeper的基本运转流程:1、选举Leader。2、同步数据。3、选举Leader过程中算法有很多,但要达到的选举标准是一致的。4、Leader要具有最高的执行ID,类似root权限。5、集群中大多数的机器得到响应并接受选出的Leader。生产故障|Kafka消息发送延迟达到几十秒的罪魁祸首竟然是...

在双十一期间,负责的Kafka集群响应时间飙升至至秒,严重影响了消息写入。通过对日志分析,发现存在大面积分区Leader选举问题,特别是__consumer_offsets主题的分区。最终确定了故障根源:Broker节点与Zookeeper会话超时,触发了大量分区重新选举。本文将剖析Zookeeper在Kafka中的关键作用及故障分析过程,提供排查问题的ngrok 2.1 源码下载启示。

Zookeeper在Kafka架构中扮演着至关重要的角色,尤其是在控制器选举、Broker节点故障实时发现等方面。在Zookeeper中,通过创建临时节点+事件监听机制,可以实现实时数据动态感知。本文重点介绍/brokers目录的布局与作用,以及/brokers/ids目录的实现方式。

Kafka对Zookeeper的依赖性非常大,特别是Kafka控制器和Broker节点的存活状态都依赖于Zookeeper。控制器作为整个Kafka集群的“大脑”,其异常会导致广泛的影响。故障分析将通过具体实例展示这一过程。

在故障发现阶段,观察到客户端请求未到达Kafka排队队列,以及专门用于处理网络读写的线程池空闲,消息发送响应时间长但服务端线程空闲,情况异常。通过查看服务端日志,发现大量主题(包括__consumer_offsets)进行Leader选举。核心日志显示“start at Leader Epoch”信息,指出分区在进行Leader选举。这种情况下,只有Leader分区能处理读、写请求,而Follower分区仅复制数据。分区进行Leader选举时无法处理客户端写入请求,导致发送端有重试机制,消息发送延迟明显。

大量主题进行重新选举的触发条件是什么?通过查看当前集群的Controller节点日志,发现分区状态从OnlinePartition变更为OfflinePartition。进一步分析发现,Broker与Zookeeper的会话超时导致临时节点被移除。会话超时会给Kafka集群带来严重影响,特别是当Broker节点被移除时,Kafka控制器会将该节点上分配的所有分区状态变更,触发分区重新选举。此外,当Controller节点被移除时,不仅会导致Controller选举,还会触发Kafka控制器相关事件监听器重新注册、分区状态机和副本状态机的停止与重新启动,各个分区会自动进行leader选举。

排查Zookeeper会话超时的根源,通过服务端日志观察到“Closed socket connection for client”信息,提示客户端主动关闭连接。进一步分析发现,心跳处理机制是定时向服务端发送心跳包,若在指定时间内未收到或处理心跳包,则会导致会话超时。通过阅读源码,发现客户端会将请求放入队列,由发送线程从队列中获取并发送到服务端。在大量Zookeeper更新操作下,心跳处理可能未能及时进行,导致在会话超时前集群频繁更新Zookeeper,触发客户端心跳超时。

综上所述,由于Zookeeper会话超时导致大量分区重新选举,最终造成消息发送延迟和消费组大面积重平衡。通过这一故障分析,我们明确了问题的根本原因,并为排查类似问题提供了思路。本文到此结束,期待下期分享更多Kafka相关知识。

-Zookeeper指标分析

通过CDH管理平台访问Zookeeper管理界面,发现Zookeeper的平均请求延迟、最小请求延迟、最大请求延迟指标趋势图不变,指标数据异常。

在复现问题时,注意到平均请求延迟、最小请求延迟、最大请求延迟这三个指标未发生变化,且指标数据出现异常。

分析问题源码后发现,指标数据来源于Zookeeper自身的ServerStats模块。此模块通过updateLatency方法来更新maxLatency和minLatency指标。

在深入研究代码后,我们了解到maxLatency和minLatency指标记录了Zookeeper服务器启动后所有请求的最大延迟和最小延迟。在特定情况下,Zookeeper服务器1通过一次请求更新了maxLatency指标为ms后,后续所有请求均未超过此值,导致CDH平台获取的maxLatency指标始终为ms,造成最大请求延迟指标维持不变的异常。

同样,当Zookeeper服务器1在通过一次请求后更新了minLatency指标为0ms,且后续所有请求均未小于此值,使得CDH平台获取的minLatency指标始终为0ms,从而出现最小请求延迟指标为0ms并维持不变的异常。

对于avgLatency指标,其通过累计所有请求的延迟时间(totalLatency)和累计请求次数(count),再通过totalLatency/count计算得出。如果多次请求的延迟均为0ms,那么avgLatency指标将保持为0ms。

解决此问题的关键在于确保Zookeeper服务器在处理请求时,能正常更新并反馈请求延迟指标,避免出现数据异常的情况。同时,为确保数据的准确性和可靠性,建议定期检查和维护Zookeeper服务器,以确保其正常运行并准确提供指标数据。

关注微信公众号“Hadoop实操”,获取更多Hadoop技术干货。欢迎分享和转发。

本文原创,如需转载,请注明转载自微信公众号“Hadoop实操”。

ZookeeperApach Curator 框架源码分析:初始化过程(一)Ver 4.3.0

Curator是由Netflix开源的一款用于简化Zookeeper客户端开发的工具,它提供了一套高级别API,使得开发者可以更简单易懂地实现分布式应用程序。Curator构建在Zookeeper原生客户端之上,提供了连接重试、异常处理、节点监听等常见功能,减轻了开发者的工作负担。Curator由多个模块组成,其中curator-framework和curator-recipes是最常用的部分,此外还提供了分布式锁等功能。

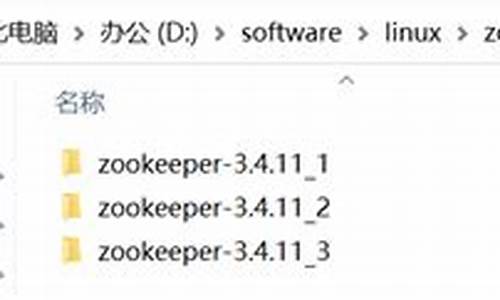

Curator的最新版本为5.X系列,不再支持ZK 3.4.X及之前的版本。主要的改动在5.X系列中,原因包括代码重构、API调整等,导致不兼容之前的版本。

Curator的下载地址可以通过Maven依赖管理或Apache官方网站获取。要开始使用Curator,需要搭建Zookeeper集群环境,详细部署过程可参考其他文章。

引入Curator依赖后,开发者可以使用CuratorFrameworkFactory构建实例,通过此实例连接Zookeeper集群并执行分布式操作,如分布式锁等。Curator内部实现了重试策略、连接管理等,使得操作更为便捷且稳定。

Curator提供了可重入锁(公平锁)的示例,开发者可以通过简单的代码实现分布式锁功能。初始化CuratorFramework实例的过程包括设置连接参数、构建实例、启动连接等步骤,内部会处理网络重连、异常处理等逻辑。

在Curator的初始化过程中,CuratorFrameworkImpl是核心类,它负责构建与Zookeeper集群的连接,并封装了一系列关键组件,如连接管理、异常检测、负载均衡等。CuratorZookeeperClient类负责Zookeeper客户端的封装和调用。

CuratorFrameworkImpl的启动过程涉及初始化连接状态管理器、启动客户端连接、执行后台操作等关键步骤。通过CAS操作确保线程安全,并在异常情况下自动重试连接。

连接状态管理器(ConnectionStateManager)负责维护连接状态并处理状态变更通知,确保在状态改变时能够及时通知到监听器。通知机制包括注册一次性监听器、注册CuratorListener和ConnectionStateListener,以及处理未处理的错误。

Curator的会话管理机制包括连接状态检查和重连策略,确保在连接断开后能够自动恢复连接。在状态变更时,连接状态管理器会通知所有注册的监听器,执行相应的回调逻辑。

Curator还提供了缓存机制,用于保存节点数据并在数据发生变化时进行更新。此外,Curator支持多次注册监听器,确保在连接断开后能够重新注册监听器,以避免丢失监听事件。

通过上述分析,Curator为开发者提供了高效、稳定的Zookeeper客户端实现,简化了分布式应用程序的开发过程。在实际应用中,开发者需要根据项目需求选择合适的版本和功能模块,以充分利用Curator提供的便利性。