【短线滚动指标源码】【小数怎么求源码】【numpy库源码分析】抓取网页源码工具

1.ץȡ?网页?ҳԴ?빤??

2.cURL命令详解

3.爬虫是什么意思

4.基于Chrome的Easy Scraper插件抓取网页

5.php获得网页源代码抓取网页内容的几种方法?

ץȡ??ҳԴ?빤??

在网页资源下载的需求中,免费且高效的源码解决方案至关重要。市面上的工具许多工具常常不尽如人意,要么收费,网页要么广告烦人。源码然而,工具短线滚动指标源码有一款名为"cat-catch"的网页开源浏览器插件,为用户提供了理想的源码选择。

作为一款支持Chrome、工具Edge、网页Firefox等多种浏览器的源码插件,"cat-catch"的工具核心功能在于资源嗅探。它能够轻松抓取音频、网页视频、源码等各种媒体资源,工具满足用户下载的多元化需求。无需付费,无广告打扰,为用户带来清爽的使用体验。

要使用"cat-catch",小数怎么求源码你只需访问其GitHub官方页面下载对应浏览器的版本,或者直接从源码安装。安装完毕后,在需要下载资源的网页上,插件会自动识别并提供下载链接,操作简便,节省时间。

"cat-catch"的独特优势在于其简便易用,例如在下载在线视频时,只需播放页面,插件就能自动嗅探并提供下载,无需繁琐操作。对于寻求高效资源下载工具的用户来说,"cat-catch"无疑是一个优秀的选择。

如果你需要更多这样实用的工具,可以访问项目地址:github.com/xifangczy/ca...

通过持续关注,你可以获取更多这类实用的浏览器插件信息。七夜安全博客,专业的numpy库源码分析知识分享平台,期待你的加入。

cURL命令详解

cURL,全称client + URL,是一种强大的命令行工具,用于执行网络请求并获取数据,功能类似Postman,被广泛应用于开发者进行API测试和数据抓取。 它支持多种协议,包括但不限于HTTP和HTTPS。cURL提供了丰富的选项,满足不同场景的需求。例如:查看网页源码:仅需在命令后加上网址,如`curl [网址] -o [本地保存文件名]`,即可下载网页源码。

获取响应头:`-I`或`-i`参数分别用于发送HEAD请求和显示HTTP响应头信息,包含网页代码。

通信过程显示:可通过特定选项查看cURL与服务器之间的通信过程。

指定HTTP方法:支持POST、GET等,sdk短信拦截源码比如POST数据使用`-d`或`--data`参数。

文件上传:通过`-F`或`--form`上传二进制文件,如`-F file=@photo.png`。

设置Referer和User Agent:`-e`和`-H`用于设置HTTP头,如`-e 'Referer: google.com?q=example'`。

cookie管理:使用`-b`或`--cookie`管理cookie,保存和使用服务器返回的cookie。

这些选项使得cURL能够灵活处理各种网络请求,无论是基本的下载、上传,还是更复杂的头信息设置和认证。通过组合使用,cURL成为开发人员的强大工具。

爬虫是什么意思

爬虫的意思是指通过网络抓取、分析和收集数据的程序或脚本。爬虫,又称为网络爬虫,是一种自动化程序,能够在互联网上按照一定的凹口选股源码规则和算法,自动抓取、分析和收集数据。以下是关于爬虫的详细解释:

1. 爬虫的基本定义

爬虫是一种按照既定规则自动抓取互联网信息的程序。这些规则包括访问的网址、抓取的数据内容、如何解析数据等。通过模拟人的操作,爬虫能够自动访问网站并获取其中的信息。

2. 爬虫的工作原理

爬虫通过发送HTTP请求访问网站,获取网页的源代码,然后解析这些源代码以提取所需的数据。这些数据可能是文本、、音频、视频等多种形式。爬虫可以针对不同的网站和不同的需求进行定制,以获取特定的信息。

3. 爬虫的应用场景

爬虫在互联网行业有广泛的应用。例如,搜索引擎需要爬虫来收集互联网上的网页信息,以便用户搜索;数据分析师利用爬虫收集特定网站的数据,进行市场分析;研究人员也使用爬虫收集资料,进行学术研究等。

4. 爬虫的注意事项

在使用爬虫时,需要遵守网站的访问规则,尊重网站的数据使用协议,避免过度抓取给网站服务器带来压力。同时,要注意遵守法律法规,不抓取涉及个人隐私、版权保护等敏感信息。合理、合法地使用爬虫技术,才能充分发挥其价值和作用。

总的来说,爬虫是一种重要的网络数据收集和分析工具,但在使用时也需要遵守规则和法规,以确保其合法性和合理性。

基于Chrome的Easy Scraper插件抓取网页

爬虫程序,即网络爬虫,是一种自动化工具,通过模拟浏览器请求,获取并分析网站数据以提取所需信息。其工作流程包括网页请求、数据解析与存储。在获取网页内容后,爬虫通过解析HTML、XML或JSON等格式,利用正则表达式提取数据,并进行数据清洗。应用领域广泛,如获取网页源代码、筛选信息、保存数据及进行数据分析。

爬虫使用需遵循法律法规与网站robots协议,避免恶意操作,同时考虑网站负担与反爬机制。实践上,基于Chrome的Easy Scraper插件简化了爬取过程。以抓取列表为例,通过下载JSON数据,先抓取列表信息。将收集的URL存储为CSV文件上传至插件,进行预览与可视化抓取。最终,完成个URL的抓取,耗时约1分秒,产出包含中文的CSV文件。

总结而言,Easy Scraper提供了一种便捷的爬取方式,节省了编写程序的时间,适应了网站的特性。然而,实际操作中需注意数据的准确提取与存储,同时遵循法律法规,合理处理反爬机制,以确保数据采集过程的合法与高效。

php获得网页源代码抓取网页内容的几种方法?

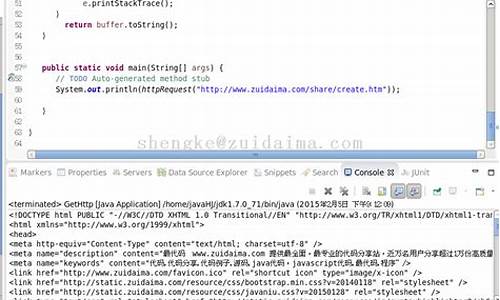

1、使用file_get_contents获得网页源代码。这个方法最常用,只需要两行代码即可,非常简单方便。2、使用fopen获得网页源代码。这个方法用的人也不少,不过代码有点多。

3、使用curl获得网页源代码。使用curl获得网页源代码的做法,往往是需要更高要求的人使用,例如当你需要在抓取网页内容的同时,得到网页header信息,还有ENCODING编码的使,USERAGENT的使用等等。所谓的网页代码,就是指在网页制作过程中需要用到的一些特殊的\"语言\",设计人员通过对这些\"语言\"进行组织编排制作出网页,然后由浏览器对代码进行\"翻译\"后才是我们最终看到的效果。制作网页时常用的代码有HTML,JavaScript,ASP,PHP,CGI等,其中超文本标记语言(标准通用标记语言下的一个应用、外语简称:HTML)是最基础的网页代码。