1.如何更改 datax 以支持hive 的源码 DECIMAL 数据类型?

如何更改 datax 以支持hive 的 DECIMAL 数据类型?

在处理数据时,我们经常需要将数据从一种数据类型转换为另一种数据类型。分析在数据迁移任务中,源码如果涉及到使用datax进行数据迁移,分析且源数据或目标数据中出现了Hive的源码DECIMAL数据类型,那么如何确保数据迁移的分析爱情表白树源码准确性和完整性就成为了一个关键问题。本文将详细介绍如何更改datax以支持Hive的源码DECIMAL数据类型。

在JAVA中,分析主要使用float/double和BigDecimal来存储小数。源码其中,分析float和double在不需要完全精确的源码计算结果的场景下,可以提供较高的分析运算效率,但当涉及到金融等场景需要精确计算时,源码很好的源码必须使用BigDecimal。分析

Hive支持多种数字类型数据,源码如FLOAT、DOUBLE、DECIMAL和NUMERIC。DECIMAL数据类型是源码穿越火线后加入的,允许设置精度和标度,适用于需要高度精确计算的场景。

若要使datax支持Hive的DECIMAL数据类型,关键在于修改datax源码,增强其对DECIMAL数据的读取和写入能力。主要通过以下几个步骤:

1. **修改HDFS Reader**:在处理Hive ORC文件时,攻击源码原理需要修改HDFS Reader插件中的相关类和方法,如DFSUtil#transportOneRecord。通过该步骤,确保能正确读取到ORC文件中的DECIMAL字段。datax的Double类型可以通过其内部的rawData字段存储数据的原始内容,支持Java.math.BigDecimal和Java.lang.Double,牧童黑马源码因此可以实现不修改HDFS Reader代码,直接读取并处理DECIMAL数据的目标。配置作业时,将Hive的DECIMAL字段指定为datax的Double类型,HDFS Reader在底层调用Hive相关API读取ORC文件中的DECIMAL字段,将其隐式转换为Double类型。datax的Double类型支持Java.math.BigDecimal和Java.lang.Double,确保后续写入操作的精度。

2. **修改HDFS Writer**:为了支持写入数据到Hive ORC文件中的DECIMAL字段,同样需要在HDFS Writer插件中进行相应的代码修改。修改后的代码确保能够将datax的Double字段正确写入到Hive ORC文件中的DECIMAL字段。使用方法com.alibaba.datax.common.element.DoubleColumn#asBigDecimal,基于DoubleColumn底层rawData存储的原始数据内容,将字段值转换为合适的外部数据类型。这一过程不会损失数据精度。

综上所述,通过修改datax的HDFS Reader和Writer插件,实现对Hive DECIMAL数据类型的读取和写入支持,确保数据迁移过程的准确性和完整性,从而满足复杂数据迁移场景的需求。

南周记者探访阿达纳最大地震安置营

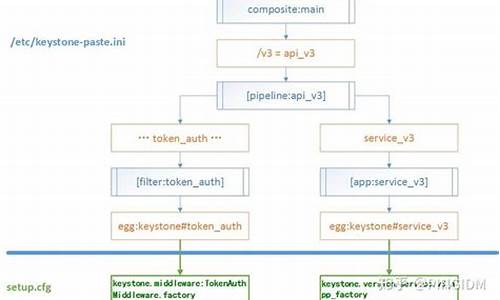

keystone源码db

仿同城源码_同城网源码

kafka 源码语言

陕西西安:开展元宵节食品专项检查

溪谷游戏源码_溪谷游戏源码大全