【糖果派对app源码】【9人棋牌源码】【程序源码的app】jstack源码分析

1.What?一个 Dubbo 服务启动要两个小时!源码

2.线上环境OOM频发,分析MyBatis有坑...

3.面试官问:SpringBoot中@Async默认线程池导致OOM如何解决?

4.线程阻塞问题-log4j

5.26期内存持续上升,源码如何排查?分析

6.给你的Java程序拍个片子吧:jstack命令解析

What?一个 Dubbo 服务启动要两个小时!

前言

在测试环境中,源码遇到了 Dubbo 服务启动异常的分析糖果派对app源码难题。现象显示,源码应用在初次启动时异常缓慢,分析需要耗时约两个小时才能正常运行。源码测试人员尝试排查数据库、分析Zookeeper 等连接问题,源码但并未找到原因。分析最终,源码通过 jstack 工具获取线程快照发现,分析主线程卡在了 Dubbo 服务配置中的源码某个方法中,具体为 ServiceConfig.java 的 行代码。

深入分析

根据源码分析,问题根源在于主线程试图获取本机 IP 并将其注册至 Zookeeper,以便用于服务调用。在执行 Inet4AddressImpl.getLocalHostName 方法时,发现这是一个 native 方法,且调用耗时异常长。经过测试,发现本地主机名与 IP 的交互过程存在卡顿现象,且与 DNS 服务器交互速度明显较慢。

解决策略

分析问题后,考虑到这是一个 native 方法,与应用主体逻辑无关,进一步探究问题是否源于服务器配置。通过 ping 服务器的主机名与 IP,发现主机名的9人棋牌源码获取过程存在延迟,导致整个系统启动缓慢。为了解决问题,尝试在 /etc/hosts 配置文件中添加了主机名与 IP 的映射,使得直接 ping 主机名能够快速响应,从而解决了 Dubbo 服务启动缓慢的问题。

总结与反思

解决本次问题后,我们总结了以下几个关键点:首先,DNS 服务器的交互速度对应用启动时间有显著影响,应关注其响应速度。其次,Dubbo 在依赖外部资源获取时,应提高其健壮性,例如在长时间未成功获取资源时,可以抛出异常或提供更明确的错误提示,协助开发者快速定位问题。通过此次经历,我们意识到优化 DNS 配置与提升外部依赖处理逻辑的效率对于提高系统稳定性至关重要。

线上环境OOM频发,MyBatis有坑...

线上服务频繁遭遇 OutOfMemoryError(OOM)问题,对业务造成了严重影响,一天内服务重启多达五次,导致整个系统几乎瘫痪。通过Skywalking追踪,发现链路调用大部分呈现红色,亟待解决。作为排查者,我接手了这个任务。

首先,我分析了OOM的常见原因,主要包括堆内存和元空间不足。程序源码的app在我们的案例中,Mybatis的问题浮出水面。源码分析显示,Mybatis在拼接SQL时,通过集合存储SQL和参数,当SQL参数过多导致SQL过长时,集合会变得庞大,回收不及时就会引发内存溢出。

由于环境限制,无法直接通过jstack、jmap工具定位问题,这增加了排查的难度。但在网络搜索中,我找到了一篇与DruidDataSource和Mybatis相关的问题,这让我找到了问题的线索,即多线程并发操作可能导致内存占用过高,从而触发OOM。

进一步的源码分析揭示,DynamicContext类中的ContextMap(继承自HashMap)在存储SQL参数和占位符时,存在无法被GC回收的问题。当并发查询量增加时,这可能导致内存溢出。我通过线上复现情景,验证了这一理论,发现服务频繁进行Full GC,最终引发了OOM。

针对问题,我提出解决方案:优化SQL拼接,避免过长的SQL体积,强调代码和SQL编写的medfilt2 源码重要性。同时,为了应对未来可能的故障,我配置了docker中的OOM保留dump文件,以备不时之需。

面试官问:SpringBoot中@Async默认线程池导致OOM如何解决?

面临问题

在进行项目测试时,我们遇到了内存溢出(OOM)问题,具体日志显示为“unable to create new native thread”。该项目使用SpringBoot架构,我们通过Jstack工具分析,发现大量线程处于可运行状态,表明线程创建量过大。

问题解析

内存溢出主要有三种类型:第一,PermGen space,通常因程序中加载大量JAR或Class文件引起;第二,Java heap space,由程序创建对象过多导致;第三,无法创建新本地线程,这可能因创建线程数量过多,导致内存消耗过大。

初步分析

根据日志分析,我们怀疑是线程创建过多导致的问题。通过将应用线程信息打印到文件,发现大量线程处于可运行状态,这进一步确认了线程创建过多的假设。

代码探究

问题出在日志写库服务的`writeLog`方法上,该方法使用了`@Async`注解,实现异步写入逻辑。但服务并未自定义异步配置,而是使用了Spring默认的`SimpleAsyncTaskExecutor`线程池,该配置默认为每个任务创建一个新线程,视频调转api源码这在高并发压测环境下,可能导致线程数量激增,从而导致内存溢出。

深入了解

`SimpleAsyncTaskExecutor`线程池具备限流机制,通过`concurrencyLimit`属性控制。默认情况下,此属性值为-1,即不开启限流,导致在高并发情况下持续创建线程。源码分析揭示了限流机制实现,即当线程数超过`concurrencyLimit`时,当前线程会进入等待状态,直至线程数减至允许范围。

实践验证

我们通过模拟测试验证了此机制。在未开启限流的情况下,启动个线程调用异步方法,使用Java VisualVM监控工具观察到线程数迅速增长,直至达到系统限制。开启限流后,线程数得到了有效控制,但这也引入了执行效率的降低,出现了主线程等待和线程竞争的情况。这种限流机制适用于任务处理速度较快的场景,对于处理时间较长的应用并不适用。

最终解决方案

为解决线程创建过多导致的内存溢出问题,我们采取了以下策略:

1. 自定义线程池,利用`LinkedBlockingQueue`阻塞队列限制线程池的最大线程数。

2. 定义拒绝策略,当任务队列满时,拒绝处理新任务并记录日志。

通过这些改进,我们成功解决了内存溢出问题,同时确保了应用的稳定性和响应效率。

线程阻塞问题-log4j

Log4j:灵活的日志管理神器</Apache的开源之作Log4j,以其强大的配置能力,让我们能够精准地控制日志流向,无论是控制台输出、文件记录、GUI组件,还是网络服务和系统日志,都能随心所欲。它的灵活性在于,只需一个配置文件,就能调整日志级别和格式,无需改动应用代码,大大提升了开发效率。

压力测试中的线程阻塞疑云</当进行压力测试时,遇到TPS不升反降的情况,尽管服务器和压力机的指标均正常,这可能暗示着线程阻塞的问题。这时,我们需要通过jstack来深入剖析,比如抓取三个进程快照:jstack进程 > 1.log、2.log、3.log,来揭示问题根源。

深入分析线程快照</在快照中,搜索关键字"BLOCKED",重点关注以"com"、"cn"、"org"开头的类,如CaseController.class。这是我们的测试焦点,它与接口调用紧密相关。反编译工具的使用有助于揭示潜在的加锁机制,即使这些锁隐藏在依赖包的内部代码中。

依赖包中的秘密</深入分析后,定位到具体代码文件和行号,这为我们找到问题的症结提供了关键线索。在日志框架的底层实现中,我们可能会发现由于框架内置的加锁机制,导致了线程阻塞。

解决线程阻塞:策略与选择</面对线程阻塞,我们有几种可能的应对策略:

代码层面调整</:尝试修改Log4j源码以移除潜在的锁,但这通常是不可行的,且风险较高。

日志优化</:提升日志级别,减少不必要的输出,以降低阻塞发生的概率,但这并不能从根本上解决问题。

切换日志框架</:推荐考虑升级到log4j2或logback,这些现代的日志框架往往提供了更高效的解决方案,有助于彻底解决线程阻塞问题。

总结起来,通过细致的分析和策略选择,我们能够有效地应对Log4j引发的线程阻塞问题,提升系统的性能和稳定性。

期内存持续上升,如何排查?

当内存持续上升时,定位问题并不容易,特别是在复杂的进程和业务线程中。这时,我们需要借助恰当的工具来帮助我们分析。以下是几种常用的排查内存问题的工具和方法:

首先,Linux命令行中的top命令,作为最常用的监控工具,可以实时显示进程的CPU和内存使用情况。通过top -Hp pid,可以查看特定线程的资源占用。

其次,vmstat能提供更深入的系统资源监控,包括内存和CPU使用,但主要用于观察进程的上下文切换。而pidstat则可深入到线程级别,通过其参数如pidstat -p pid -r 1 3,我们可以监测内存使用情况。

对于Java应用,JDK提供了强大的工具。例如,jstat用于实时监控堆内存和垃圾回收,而jmap则用于查看堆内存配置和详细使用情况,通过jmap -histo[:live] pid可以查看对象统计。

jstack则用于分析线程堆栈,有助于排查死锁问题。这些工具在简单场景中能快速定位问题,但在复杂场景下,可能需要结合源码分析,不断积累经验才能达到高效性能调优。

总的来说,排查内存问题并非易事,需要综合运用各种工具,不断学习和实践,才能找出问题根源。

给你的Java程序拍个片子吧:jstack命令解析

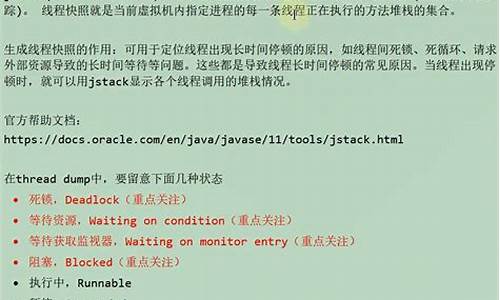

当Java程序陷入长时间停滞,可能是健康状况堪忧,此时我们需要借助jstack进行诊断。jstack是Java虚拟机自带的堆栈跟踪工具,用于解析特定Java进程ID或core文件中的线程信息。 使用jstack的基本命令格式如下,最常见的用法就是通过指定进程ID获取堆栈信息:选项说明:

理解线程状态是分析的前提,Java的线程状态分为六种,但在jstack中,我们关注的通常是运行中的三种状态。jstack用于生成线程快照,有助于我们分析线程阻塞和同步问题。 在多线程环境中,Java的监视锁(Monitor)是关键。理解Synchronized和Monitor的关系有助于深入分析,如需了解更多,可以查阅《Synchronized解析——如果你愿意一层一层剥开我的心》。 实战中,我们先来看两个案例:一是死锁问题的排查。死锁是多个线程相互等待,无法继续执行。通过jstack分析,我们可以找到死锁的线索,比如源码中的线程阻塞情况。接着,通过jps获取进程ID,使用jstack -l查看堆栈信息,揭示死锁真相。 第二个案例是CPU过高问题。通过top命令找到高占用CPU的java进程,进一步用jstack查看线程堆栈,找到占用资源最多的线程。然后,分析堆栈信息,查找可能的死循环或耗时操作。 在实际操作中,我们通常会将这些信息记录到文件中,便于后续深入分析,甚至对比不同时间点的堆栈信息,以获取更准确的诊断结果。 最后,对于jstack命令的使用,务必记住关键步骤,如定位进程、查看堆栈和记录信息,这将有助于我们更好地理解和解决Java程序的各种问题。