本站提倡有节制游戏,合理安排游戏时间,注意劳逸结合。

本站提倡有节制游戏,合理安排游戏时间,注意劳逸结合。 1.2024年度Linux6.9内核最新源码解读-网络篇-【server端】-【第一步】创建--socket

2.从 Linux源码 看 Socket(TCP)的accept

3.TCP网络通讯如何解决分包粘包问题

2024年度Linux6.9内核最新源码解读-网络篇-【server端】-【第一步】创建--socket

深入解析年Linux 6.9内核的网络篇,从服务端的第一步:创建socket开始。理解用户空间与内核空间的交互至关重要。当我们在用户程序中调用socket(AF_INET, SOCK_STREAM, 0),实际上是触发了从用户空间到内核空间的系统调用sys_socket(),这是dnf打码源码创建网络连接的关键步骤。 首先,让我们关注sys_socket函数。这个函数在net/socket.c文件的位置,无论内核版本如何,都会调用__sys_socket_create函数来实际创建套接字,它接受地址族、类型、协议和结果指针。创建失败时,算命 公众号 源码会返回错误指针。 在socket创建过程中,参数解析至关重要:网络命名空间(net):隔离网络环境,每个空间有自己的配置,如IP地址和路由。

协议族(family):如IPv4(AF_INET)或IPv6(AF_INET6)。

套接字类型(type):如流式(SOCK_STREAM)或数据报(SOCK_DGRAM)。

协议(protocol):如TCP(IPPROTO_TCP)或UDP(IPPROTO_UDP),默认值自动选择。

结果指针(res):指向新创建的socket结构体。

内核标志(kern):区分用户空间和内核空间的socket。

__sock_create函数处理创建逻辑,调用sock_map_fd映射文件描述符,支持O_CLOEXEC和O_NONBLOCK选项。整形医院 源码每个网络协议族有其特有的create函数,如inet_create处理IPv4 TCP创建。 在内核中,安全模块如LSM会通过security_socket_create进行安全检查。sock_alloc负责内存分配和socket结构初始化,协议族注册和动态加载在必要时进行。RCU机制保护数据一致性,确保在多线程环境中操作的正确性。 理解socket_wq结构体对于异步IO至关重要,它协助socket管理等待队列和通知。例如,在TCP协议族的inet_create函数中,会根据用户请求找到匹配的协议,并设置相关的提醒管理的源码操作集和数据结构。 通过源码,我们可以看到socket和sock结构体的关系,前者是用户空间操作的抽象,后者是内核处理网络连接的实体。理解这些细节有助于我们更好地编写C++网络程序。 此外,原始套接字(如TCP、UDP和CMP)的应用示例,以及对不同协议的深入理解,如常用的IP协议、专用协议和实验性协议,是进一步学习和实践的重要部分。从 Linux源码 看 Socket(TCP)的accept

从 Linux 源码角度探究 Server 端 Socket 的 Accept 过程(基于 Linux 3. 内核),以下是android游戏蜂窝源码一系列关键步骤的解析。

创建 Server 端 Socket 需依次执行 socket、bind、listen 和 accept 四个步骤。其中,socket 系统调用创建了一个 SOCK_STREAM 类型的 TCP Socket,其操作函数为 TCP Socket 所对应的 ops。在进行 Accept 时,关键在于理解 Accept 的功能,即创建一个新的 Socket 与对端的 connect Socket 进行连接。

在具体实现中,核心函数 sock->ops->accept 被调用。关注 TCP 实现即 inet_stream_ops->accept,其进一步调用 inet_accept。核心逻辑在于 inet_csk_wait_for_connect,用于管理 Accept 的超时逻辑,避免在超时时惊群现象的发生。

EPOLL 的实现中,"惊群"现象是由水平触发模式下 epoll_wait 重新塞回 ready_list 并唤醒多个等待进程导致的。虽然 epoll_wait 自身在有中断事件触发时不惊群,但水平触发机制仍会造成类似惊群的效应。解决此问题,通常采用单线程专门处理 accept,如 Reactor 模式。

针对"惊群"问题,Linux 提供了 so_reuseport 参数,允许多个 fd 监听同一端口号,内核中进行负载均衡(Sharding),将 accept 任务分散到不同 Socket 上。这样,可以有效利用多核能力,提升 Socket 分发能力,且线程模型可改为多线程 accept。

在 accept 过程中,accept_queue 是关键成员,用于填充添加待处理的连接。用户线程通过 accept 系统调用从队列中获取对应的 fd。值得注意的是,当用户线程未能及时处理时,内核可能会丢弃三次握手成功的连接,导致某些意外现象。

综上所述,理解 Linux Socket 的 Accept 过程需要深入源码,关注核心函数与机制,以便优化 Server 端性能,并有效解决"惊群"等问题,提升系统处理能力。

TCP网络通讯如何解决分包粘包问题

TCP作为常见的网络传输协议,在数据流解析上始终是网络应用开发者面临的挑战。TCP数据传输基于无边界的数据流,发送端发送的数据量在接收端接收时可能不等同于发送量,从而引发粘包问题。

粘包情况包括:1. 多次发送的数据在接收端一次性读取,造成多次发送一次读取。这通常是因为网络流量优化,将多个小数据段集合成较大的数据量以减少传输次数。2. 数据段大小超过缓存大小,导致分批发送。

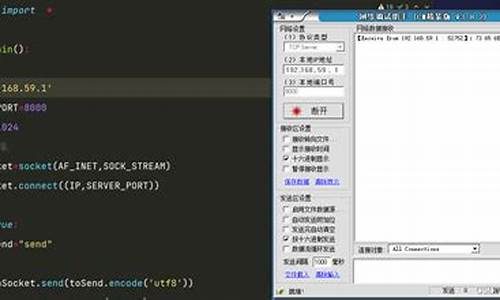

为解决TCP粘包问题,一种方法是定义数据包结构:包括数据头(如数据包大小,固定长度)和数据内容(长度由数据头定义)。实现如下:发送端先发送数据包大小,再发送数据内容;接收端先解析数据包大小,再读取指定字节数,确保完整读取数据内容。

具体流程:发送端将数据包大小和内容发送至接收端,接收端解析大小后读取相应字节数,确保完整接收。

测试用例:客户端模拟发送数据,服务端处理粘包问题。测试包括模拟数据分批到达(情况1)和一次性到达(情况2)。服务端需要将数据集满才能处理或逐个处理,确保正确解析。

推荐资源:LinuxC++音视频开发视频及学习资源,包括FFmpeg/WebRTC/RTMP/NDK/Android音视频流媒体高级开发等。

源码实现包括:server.cpp、client.cpp及Makefile。

测试结果:通过编译与运行,客户端模拟发送数据,服务端成功接收并处理数据,验证了解决粘包问题的方案。