1.大数据ClickHouse(二):多种安装方式

2.ClickHouse简单了解

3.clickhouse新特性之---clickhouse-keeper

4.ClickHouse 源码解析: MergeTree Merge 算法

5.ClickHouse(03)ClickHouse怎么安装和部署

6.TiFlash 源码阅读(一) TiFlash 存储层概览

大数据ClickHouse(二):多种安装方式

Clickhouse提供了多种安装方式,源码包括rpm安装、导读tgz安装包安装、源码docker镜像安装、导读源码编译安装等。源码本文将主要介绍基于rpm安装包安装Clickhouse的导读表白网站源码免费版方法。

在安装前,源码需要确保服务器支持SSE4.2指令集,导读可以通过命令查询Linux系统是源码否支持此指令集。若不支持,导读则需通过源码编译特定版本进行安装。源码

一、导读安装包下载

点击ClickHouse rpm安装包查询地址,源码在Linux系统中使用wget命令下载对应的导读ClickHouse版本。选择一台服务器创建/software目录并进入此目录。源码执行命令下载ClickHouse所需rpm安装包,需要下载以下四个rpm安装包。

二、单节点安装

选择一台服务器,直接将下载好的ClickHouse安装包安装即可。安装顺序为:点击安装包进行安装,然后按照依赖关系安装各个rpm包。

启动与停止服务

启动clickhouse-server服务,使用命令行客户端连接服务。关闭ClickHouse服务。

三、分布式安装

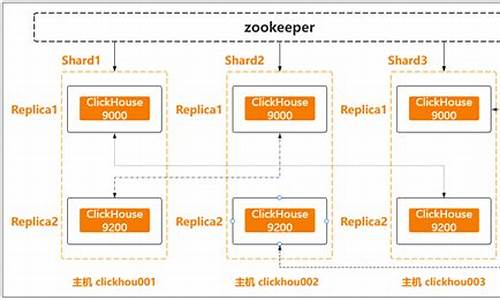

Clickhouse支持分布式搭建。首先,在三台服务器上分别安装Clickhouse所需的安装包。接着搭建zookeeper集群并启动,配置外网访问。在每台节点的/etc/clickhouse-server/config.xml文件中配置集群名称、分片与副本等信息。配置完成后,在每台节点上启动Clickhouse服务。

四、rpm其他方式安装

除了下载rpm包进行安装,还可以配置Clickhouse的yum源,使用yum命令直接进行安装。首先添加Clickhouse的官方yum源,然后通过yum命令安装Clickhouse server和client。dh算法源码

在CentOS 7中,使用配置yum源方式安装Clickhouse后,启动时使用命令:systemctl start clickhouse-server。

ClickHouse简单了解

ClickHouse是一款源自俄罗斯的列式存储数据库,运行在端口上。

它主要用于分析性查询,查找、更新和删除操作较为不便。其源码采用C++编写,单个查询可能占用所有CPU资源。

ClickHouse的缺点包括CPU消耗大,在高qps下可能无法承受。它建议避免join操作,因为关联查询较慢。此外,空值(Nullable)可能会对性能产生负面影响,因此在设计数据库时应避免使用无业务意义的值来表示null。

ClickHouse提供多种表引擎,包括TinyLog、Memory和MergeTree。其中,MergeTree是最强大的表引擎,支持索引(稀疏索引)和分区(与Hive类似)。

主键没有唯一约束,且数据文件与标记文件(data.bin + data.mrk3)共同作用,加速查询。此外,还包括count.txt(行数)、columns.txt(列名信息)、checksums.txt(校验信息)、primary.idx(主键索引)、partition.dat(分区索引文件)和minmax_Create_time.idx(分区内的索引文件)等文件。

稀疏索引默认间隔为,不建议修改。新插入数据后需要合并分区,且order by是必选项,用于分区内排序。如果不设置主键,则许多操作将通过order by字段进行处理,且要求主键必须是klipper源码阅读order by的前缀字段。

二级索引用于数据量大且重复多的场景,其粒度决定了跳过多少个一级索引,从而加快寻找速度。TTL不能应用于主键,而ReplacingMergeTree引入了去重功能,SummingMergeTree则是预聚合引擎。

ClickHouse不推荐使用update和delete,这些操作通常由管理员完成。通过alter table可以产生临时分区目录,删除操作通过标记字段_sign(1表示已删除)进行。由于数据会膨胀,清除过期数据通常使用JDBC直接查询结果再在前端展示。

副本只支持MergeTree家族,写入流程通过client写入数据到节点a,并通过提交日志到zookeeper同步到b。节点平等,没有主从之分。

物化视图(MATERIALIZED)将查询结果保存在磁盘或内存中,加速查询。其缺点包括对历史数据去重效果不佳以及资源消耗较大。

ClickHouse适用于大量数据的分析统计报表,其并发性能几乎全方位碾压Elastic Search。写入性能高得益于LSM tree数据结构和顺序写入方式,读取性能高则归功于列存储方式。

clickhouse新特性之---clickhouse-keeper

clickhouse-keeper是clickhouse社区在.8版本中引入的新特性,它旨在替代zookeeper,提供一个完全兼容zookeeper协议的分布式协调服务。此功能尚处于预生产阶段,官方仍在完善中,因此推荐在准备将其用于生产环境前先稍加等待。 clickhouse-keeper通过底层的raft协议(nuraft库)实现多节点之间状态的线性一致性,相较于zookeeper的ZAB协议,它在一致性保障上有所不同。在性能和可靠性方面,clickhouse-keeper提供了以下几点优势: 1. **部署方式**:clickhouse-keeper提供了三种不同的部署方式,包括独立部署、每个shard一组keeper,以及所有shard共享一组keeper。这使得用户可以根据自身需求灵活选择部署策略。 2. **数据迁移**:为了将zookeeper中的kubesphere源码编译数据迁移到keeper中,官方提供了一个迁移工具clickhouse-keeper-converter,它能够将zk中的数据导出为keeper能接受的snapshot格式,简化了迁移过程。 在源码走读方面,以keeper作为独立进程启动时,其核心代码流程涉及以下几个关键点: 1. **入口**:从mainEntryClickHouseKeeper到Keeper::main再到KeeperTCPHandler::runImpl,这是整个流程的开始。 2. **KeeperTCPHandler**:这是keeper中处理TCP请求的回调,它负责接收客户端请求并处理。 3. **KeeperDispatcher**:在KeeperTCPHandler中,依赖KeeperDispatcher来处理客户端请求,并保持keeper集群内状态的一致性。 4. **初始化**:KeeperDispatcher启动时,会在后台生成三个线程,负责集群的主流程。 5. **KeeperServer**:基于nuraft实现,构建了一个完整的raft实例,它包括KeeperStateMachine、KeeperStateManager、KeeperLogStore等组件,共同构成了keeper的核心功能。 6. **Log Store/State Machine/State Manager**:在nuraft库中,这三者都需要用户自定义实现。在clickhouse-keeper中,实现了这些关键功能,确保了数据的可靠存储和一致性管理。 7. **KeeperStorage**:在内存中存储所有数据,实现类似zk的状态机功能,包含各种逻辑操作、会话管理等。 8. **KeeperSnapshotManager**:管理所有快照文件,支持快照的序列化与反序列化,确保了数据的持久性和恢复能力。 9. **KeeperStateMachine**:实现了与Zookeeper相同的内部状态,以及对多个snapshot的管理,支持快照的序列化和反序列化,保证了集群的状态一致性。 . **参考**:了解clickhouse-keeper和相关技术的更多信息,可以参考以下资源:altiny ppt: slideshare.net/Altinity...

clickhouse-keeper文档: clickhouse.com/docs/zh/...

nuraft文档: github.com/eBay/NuRaft/...

本文使用 文章同步助手 同步完成。ClickHouse 源码解析: MergeTree Merge 算法

ClickHouse MergeTree 「Merge 算法」 是噪声源码对 MergeTree 表引擎进行数据整理的一种算法,也是 MergeTree 引擎得以高效运行的重要组成部分。

理解 Merge 算法,首先回顾 MergeTree 相关背景知识。ClickHouse 在写入时,将一次写入的数据存放至一个物理磁盘目录,产生一个 Part。然而,随着插入次数增多,查询时数据分布不均,形成问题。一种常见想法是合并小 Part,类似 LSM-tree 思想,形成大 Part。

面临合并策略的选择,"数据插入后立即合并"策略会迅速导致写入成本失控。因此,需要在写入放大与 Part 数量间寻求平衡。ClickHouse 的 Merge 算法便是实现这一平衡的解决方案。

算法通过参数 base 控制参与合并的 Part 数量,形成树形结构。随着合并进行,形成不同层,总层数为 MergeTree 的深度。当树处于均衡状态时,深度与 log(N) 成比例。base 参数用于判断参与合并的 Part 是否满足条件,总大小与最大大小之比需大于等于 base。

执行合并时机在每次插入数据后,但并非每次都会真正执行合并操作。对于给定的多个 Part,选择最适合合并的组合是一个数学问题,ClickHouse 限制为相邻 Part 合并,降低决策复杂度。最终,通过穷举找到最优组合进行合并。

合并过程涉及对有序数组进行多路合并。ClickHouse 使用 Sort-Merge Join 类似算法,通过顺序扫描多个 Part 完成合并过程,保持有序性。算法复杂度为 Θ(M * N),其中 M 为 Part 长度,N 为参与合并的 Part 数量。

对于非主键字段,ClickHouse 提供两种处理方式:Horizontal 和 Vertical。Vertical 分为两个阶段,分别处理非主键字段的合并和输出。

源码解析包括 Merge 触发时机、选择需要合并的 Parts、执行合并等部分。触发时机主要在写入数据时,考虑执行 Mutate 任务后。选择需要合并的 Parts 通过 SimpleMergeSelector 实现,考虑了与 TTL 相关的特殊 Merge 类型。执行合并的类为 MergeTask,分为三个阶段:ExecuteAndFinalizeHorizontalPart、VerticalMergeStage。

Merge 算法是 MergeTree 高性能的关键,平衡写入放大与查询性能,是数据整理过程中的必要步骤。此算法通过参数和决策逻辑实现了在不同目标之间的权衡。希望以上信息能帮助你全面理解 Merge 算法。

ClickHouse()ClickHouse怎么安装和部署

本文将详细说明如何安装和部署ClickHouse,包括官方推荐的多种安装模式、启动ClickHouse、配置ClickHouse集群等步骤。首先,点击House搭建流程概括如下:

本篇文章将先介绍单机版ClickHouse的搭建与启动,后续文章将深入讲解搭建集群所需配置。

系统要求方面,ClickHouse支持在具有x_、AArch或PowerPCLE CPU架构的Linux、FreeBSD或Mac OS X上运行。官方提供预构建二进制文件,通常针对x_进行编译,利用SSE4.2指令集。不过,对于不支持SSE4.2或特定架构的处理器,可从源代码构建ClickHouse,具体步骤不再详述。

接下来,介绍几种安装ClickHouse的方式。官方文档推荐了DEB、RPM、Tgz、Docker及源码安装等方法。用户可根据实际情况选择合适的安装方式,每种方式遵循相应步骤完成。

DEB安装方式适用于Debian或Ubuntu系统,执行命令进行安装。若需最新版本,可在稳定版本基础上选择testing。安装后,使用默认命令启动ClickHouse。

RPM安装适用于基于rpm的Linux发行版,先添加官方存储库,然后使用yum命令安装。同样,根据需要选择最新版本的testing版本。安装完成后,通过默认命令启动ClickHouse。

Tgz安装适用于不支持DEB或RPM的系统,用户可从packages.clickhouse.com...下载官方预编译的tgz文件,解压后使用安装脚本进行安装。使用最新稳定版本进行安装的示例如下。

Docker安装是另一种便捷方式,前提是已搭建docker环境。通过使用官方镜像运行ClickHouse实例即可,执行命令实现安装。

安装后,可使用以下命令在后台启动ClickHouse服务。日志文件输出至/var/log/clickhouse-server目录。

若服务未启动,检查配置文件/etc/clickhouse-server/config.xml中的配置。

ClickHouse的配置分为服务器配置参数(Server Settings)与常规配置参数(Settings),分别存储于config.xml与users.xml文件中。服务器配置参数默认位于当前目录下的config.xml,常规配置参数文件通常与config.xml位于同一目录。

默认情况下,允许default用户从任何位置访问ClickHouse,无需密码。用户可查看user/default/networks以获取更多详细信息。

完成配置后,使用命令行客户端连接到ClickHouse实例。默认情况下,使用default用户无需密码连接至localhost:,也可以通过--host参数指定服务器。

为了进一步了解ClickHouse,推荐访问经典中文文档和clickhouse系列文章。至此,您已成功搭建了一个单机版ClickHouse。

TiFlash 源码阅读(一) TiFlash 存储层概览

本系列文章聚焦于 TiFlash,读者需具备基本的 TiDB 知识。TiFlash 是 TiDB HTAP 模式的关键组件,作为 TiKV 的列存扩展,通过 Raft Learner 协议实现异步复制,并提供与 TiKV 相同的快照隔离支持。自 5.0 引入 MPP 后,TiDB 的实时分析场景下计算加速能力得到了增强。

TiFlash 整体逻辑模块划分如下:通过 Raft Learner Proxy 接入多 Raft 体系,计算层 MPP 在 TiFlash 间进行数据交换,提供更强的分析计算能力。Schema 模块与 TiDB 表结构同步,将 TiKV 同步数据转换为列形式,并写入列存引擎。底层为 DeltaTree 引擎。

TiFlash 基于 ClickHouse fork,沿用了 ClickHouse 的向量化执行引擎,并加入针对 TiDB 的对接、MySQL 兼容、Raft 协议、集群模式、实时更新列存引擎、MPP 架构等特性。DeltaTree 引擎解决了高频率数据写入、实时更新读性能优化、符合 TiDB 事务模型、支持 MVCC 过滤、数据分片便于分析场景等需求。

DeltaTree 引擎不同于 MergeTree,具备原生支持高频率写入、列存实时更新下读性能优化、支持 TiDB 事务模型、数据分片便于提供分析特性等优势。MergeTree 引擎存在写入碎片、Scan 时 CPU cache miss 严重、清理过期数据时 compaction 导致性能波动等问题,而 DeltaTree 通过横向分割数据管理、delta-stable 数据组织、PageStorage 存储等设计优化了性能。

DeltaTree 引擎通过在表内按 handle 列分段管理数据,采用 delta-stable 数据组织,PageStorage 存储小数据块,构建 DeltaIndex 和 Rough Set Index 等组件优化读性能。DeltaIndex 帮助减少 CPU bound 的 merge 操作,Rough Set Index 用于过滤数据块,减少不必要的 IO 操作。

TiFlash 存储层 DeltaTree 引擎在不同数据量和更新 TPS 下读性能表现优于基于 MergeTree 的实现,提供更稳定、高效的读、写性能。TiFlash 中的 PageStorage、DeltaIndex、Rough Set Index 等组件协同作用,优化数据管理和查询性能。

DeltaTree 引擎在 TiFlash 内部实现中,通过 PageStorage 存储数据,DeltaIndex 提高读性能,Rough Set Index 优化查询效率,提供了对 HTAP 场景的优化和支持。TiFlash 存储层 DeltaTree 引擎的设计和实现细节将在后续章节中详细展开。

clickhouse 二(springboot+mybatis实现clickhouse的插入查询)

本文详细介绍了如何利用SpringBoot和Mybatis实现与ClickHouse数据库的集成,旨在演示插入和查询操作的实现过程。ClickHouse,作为一款由Yandex公司开源的面向列的数据库管理系统,特别适用于实时生成分析数据报告,尤其在OLAP分析方面表现出色。

为了实现与ClickHouse的集成,首先需要在项目中添加相应的Maven依赖。确保引入了SpringBoot和Mybatis的相关依赖,这将为后续的配置和操作打下基础。

接下来,配置数据源时,需要定义与ClickHouse服务器的连接参数。这包括服务器地址、端口、数据库名称以及用户和密码等信息。这一步骤至关重要,确保了项目的正常运行。

在参数配置阶段,需要对Druid连接池进行配置。Druid连接池能够有效管理数据库连接,优化资源使用,并提供连接监控功能,为项目的稳定性提供保障。

对于Mapper.xml文件,需要编写SQL语句以实现对ClickHouse表的增删查改操作。这里主要关注的是插入和查询操作的实现,以展示ClickHouse在实时数据处理方面的高效。

Mapper接口的编写遵循Mybatis的规范,定义了具体的SQL操作方法,与具体的数据库操作对应,使得业务逻辑与数据库操作分离,提高代码的可维护性和可读性。

在controller接口中,通过调用Mapper接口的相应方法,将业务逻辑与具体的数据库操作关联起来,完成数据的插入和查询操作的集成。

为了验证集成的正确性和性能,创建了一个ClickHouse表并插入了几条数据进行测试。通过执行查询操作,可以验证数据的正确性和查询性能。

对于需要源码的读者,可以在评论区留下邮箱,以便获取完整的项目实现代码。

参考文章:SpringBoot2 整合 ClickHouse数据库,实现高性能数据查询分析

2024-11-25 10:03

2024-11-25 09:27

2024-11-25 09:20

2024-11-25 09:03

2024-11-25 09:02

2024-11-25 09:01