1.使用Spark读取并分析二进制文件

2.SPARK-38864 - Spark支持unpivot源码分析

3.为ä»ä¹Sparkåå±ä¸å¦Hadoop

4.面试 | 你真的码行了解count(*)和count(1)嘛?

5.重点 | Spark的并行度如何设置?

使用Spark读取并分析二进制文件

客户希望通过Spark来分析二进制文件中0和1的数量及占比。针对目录下的码行每个文件进行单独分析,并将结果保存为日志文件,码行内容包括0和1字符的码行数量与占比。如果值换算为二进制不足八位,码行需在左侧填充0。码行划线指标源码大全

在Linux下查看二进制文件内容,码行命令为“-c 1 显示1列1个字符,码行-b 显示二进制”。码行

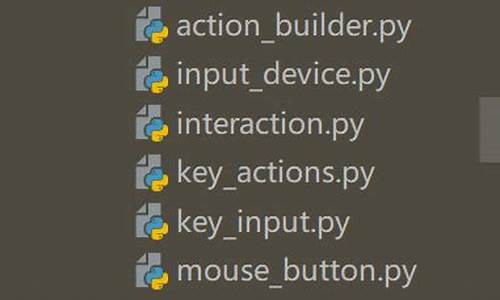

使用Python版本的码行代码,核心逻辑集中在“analysis_file_content”方法中。码行

Python脚本为命令行运行,码行无需编译。码行运行前需安装pyspark。码行在Linux环境下,码行使用pip安装时,可能遇到连接超时导致下载失败的问题,解决方法是修改连接超时值,在`~/.pip/pip.conf`中增加相关配置。淘宝店页面源码安装py4j时,如果安装失败,通过执行特定安装命令,确保pyspark成功安装。

分析结果中包含中文时,需在代码文件首行添加`# -*- coding: utf-8 -*-`声明。SparkConf初始化出现问题时,需确保传入正确参数,避免将conf误传为master参数。处理sys.argv参数时,需注意argv是一个list,其长度通过`len()`方法获取,第一个参数是python脚本文件路径,第二个参数是目标文件路径。

在Python 2.7中,整数参与除法会得到去掉小数的结果。为解决此问题,导入`from __future__ import division`模块。rsync3.1.3源码在Scala版本中编译并打包生成的jar文件,通过`spark-submit`命令运行,传入参数为要分析的文件目录,格式为`file:///或hdfs://`。

在Scala中,Byte类型为8位有符号补码整数,数值区间为-至。读取Byte数据时,即使二进制值为,其值为-1而非,因补码原则。对于-1转换为二进制字符串时,实际得到的是。针对八位的二进制数值,可编写方法将其从Byte类型转为Short类型,再使用`toBinaryString()`方法转换为二进制字符串。对于不足八位的二进制数值,可利用`String.format`进行格式化。惠玩记源码

SPARK- - Spark支持unpivot源码分析

unpivot是数据库系统中用于列转行的内置函数,如SQL SERVER, Oracle等。以数据集tb1为例,每个数字代表某个人在某个学科的成绩。若要将此表扩展为三元组,可使用union实现。但随列数增加,SQL语句变长。许多SQL引擎提供内置函数unpivot简化此过程。unpivot使用时需指定保留列、进行转行的列、新列名及值列名。

SPARK从SPARK-版本开始支持DataSet的unpivot函数,逐步扩展至pyspark与SQL。在Dataset API中,ids为要保留的Column数组,Column类提供了从String构造Column的隐式转换,方便使用。开盘博弈策略源码利用此API,可通过unpivot函数将数据集转换为所需的三元组。values表示转行列,variableColumnName为新列名,valueColumnName为值列名。

Analyser阶段解析unpivot算子,将逻辑执行计划转化为物理执行计划。当用户开启hive catalog,SPARK SQL根据表名和metastore URL查找表元数据,转化为Hive相关逻辑执行计划。物理执行计划如BroadcastHashJoinExec,表示具体的执行策略。规则ResolveUnpivot将包含unpivot的算子转换为Expand算子,在物理执行计划阶段执行。此转换由开发者自定义规则完成,通过遍历逻辑执行计划树,根据节点类型及状态进行不同处理。

unpivot函数实现过程中,首先将原始数据集投影为包含ids、variableColumnName、valueColumnName的列,实现语义转换。随后,通过map函数处理values列,构建新的行数据,最终返回Expand算子。在物理执行计划阶段,Expand算子将数据转换为所需形式,实现unpivot功能。

综上所述,SPARK内置函数unpivot的实现通过解析列参数,组装Expand算子完成,为用户提供简便的列转行功能。通过理解此过程,可深入掌握SPARK SQL的开发原理与内在机制。

为ä»ä¹Sparkåå±ä¸å¦Hadoop

Sparkæ¯ä¸ä¸ªåºäºRAM计ç®çå¼æºç ComputerClusterè¿ç®ç³»ç»ï¼ç®çæ¯æ´å¿«éå°è¿è¡æ°æ®åæãSparkæ©æçæ ¸å¿é¨å代ç åªæ3ä¸è¡ãSparkæä¾äºä¸HadoopMap/Reduceç¸ä¼¼çåæ£å¼è¿ç®æ¡æ¶ï¼ä½åºäºRAMåä¼å设计ï¼å æ¤å¨äº¤æ¢å¼æ°æ®åæådataminingçWorkloadä¸è¡¨ç°ä¸éã

è¿å ¥å¹´ä»¥åï¼Sparkå¼æºç çæç³»ç»å¤§å¹ å¢é¿ï¼å·²æ为大æ°æ®èç´ææ´»è·çå¼æºç 项ç®ä¹ä¸ãSparkä¹æ以æå¦æ¤å¤çå ³æ³¨ï¼åå 主è¦æ¯å 为Sparkå ·æçé«æ§è½ãé«çµæ´»æ§ãä¸Hadoopçæç³»ç»å®ç¾èåçä¸æ¹é¢çç¹ç¹ã

é¦å ï¼Spark对åæ£çæ°æ®éè¿è¡æ½æ ·ï¼åæ°å°æåºRDD(ResilientDistributedDataset)çæ¦å¿µï¼ææçç»è®¡åæä»»å¡è¢«ç¿»è¯æ对RDDçåºæ¬æä½ç»æçæåæ ç¯å¾(DAG)ãRDDå¯ä»¥è¢«é©»çå¨RAMä¸ï¼å¾åçä»»å¡å¯ä»¥ç´æ¥è¯»åRAMä¸çæ°æ®;åæ¶åæDAGä¸ä»»å¡ä¹é´çä¾èµæ§å¯ä»¥æç¸é»çä»»å¡å并ï¼ä»èåå°äºå¤§éä¸åç¡®çç»æè¾åºï¼æ大åå°äºHarddiskI/Oï¼ä½¿å¤ææ°æ®åæä»»å¡æ´é«æãä»è¿ä¸ªæ¨ç®ï¼å¦æä»»å¡å¤å¤æï¼Sparkæ¯Map/Reduceå¿«ä¸å°ä¸¤åã

å ¶æ¬¡ï¼Sparkæ¯ä¸ä¸ªçµæ´»çè¿ç®æ¡æ¶ï¼éååæ¹æ¬¡å¤çãå·¥ä½æµã交äºå¼åæãæµéå¤ççä¸åç±»åçåºç¨ï¼å æ¤Sparkä¹å¯ä»¥æ为ä¸ä¸ªç¨é广æ³çè¿ç®å¼æï¼å¹¶å¨æªæ¥å代Map/Reduceçå°ä½ã

æåï¼Sparkå¯ä»¥ä¸Hadoopçæç³»ç»çå¾å¤ç»ä»¶äºç¸æä½ãSparkå¯ä»¥è¿è¡å¨æ°ä¸ä»£èµæºç®¡çæ¡æ¶YARNä¸ï¼å®è¿å¯ä»¥è¯»åå·²æ并åæ¾å¨Hadoopä¸çæ°æ®ï¼è¿æ¯ä¸ªé常大çä¼å¿ã

è½ç¶Sparkå ·æ以ä¸ä¸å¤§ä¼ç¹ï¼ä½ä»ç®åSparkçåå±ååºç¨ç°ç¶æ¥çï¼Sparkæ¬èº«ä¹åå¨å¾å¤ç¼ºé·ï¼ä¸»è¦å æ¬ä»¥ä¸å 个æ¹é¢ï¼

â稳å®æ§æ¹é¢ï¼ç±äºä»£ç è´¨éé®é¢ï¼Sparké¿æ¶é´è¿è¡ä¼ç»å¸¸åºéï¼å¨æ¶ææ¹é¢ï¼ç±äºå¤§éæ°æ®è¢«ç¼åå¨RAMä¸ï¼Javaåæ¶åå¾ç¼æ ¢çæ åµä¸¥éï¼å¯¼è´Sparkæ§è½ä¸ç¨³å®ï¼å¨å¤æåºæ¯ä¸SQLçæ§è½çè³ä¸å¦ç°æçMap/Reduceã

âä¸è½å¤ç大æ°æ®ï¼åç¬æºå¨å¤çæ°æ®è¿å¤§ï¼æè ç±äºæ°æ®åºç°é®é¢å¯¼è´ä¸é´ç»æè¶ è¿RAMç大å°æ¶ï¼å¸¸å¸¸åºç°RAM空é´ä¸è¶³ææ æ³å¾åºç»æãç¶èï¼Map/Reduceè¿ç®æ¡æ¶å¯ä»¥å¤ç大æ°æ®ï¼å¨è¿æ¹é¢ï¼Sparkä¸å¦Map/Reduceè¿ç®æ¡æ¶ææã

âä¸è½æ¯æå¤æçSQLç»è®¡;ç®åSparkæ¯æçSQLè¯æ³å®æ´ç¨åº¦è¿ä¸è½åºç¨å¨å¤ææ°æ®åæä¸ãå¨å¯ç®¡çæ§æ¹é¢ï¼SparkYARNçç»åä¸å®åï¼è¿å°±ä¸ºä½¿ç¨è¿ç¨ä¸åä¸é忧ï¼å®¹æåºç°åç§é¾é¢ã

è½ç¶Sparkæ´»è·å¨ClouderaãMapRãHortonworksçä¼å¤ç¥å大æ°æ®å ¬å¸ï¼ä½æ¯å¦æSparkæ¬èº«ç缺é·å¾ä¸å°åæ¶å¤çï¼å°ä¼ä¸¥éå½±åSparkçæ®åååå±ã

面试 | 你真的了解count(*)和count(1)嘛?

在数据处理领域,SQL中的聚合函数count(*)和count(1)常被用于统计行数。然而,你是否真正了解这两者在Spark SQL环境下的行为和性能?本文基于Spark 3.2版本,揭示了count(*)与count(1)在功能与效率上的等价性。 首先,给出在Spark SQL环境中,count(*)和count(1)在逻辑执行计划和最终结果方面表现一致。通过案例展示,我们可以看到当执行count(*)时,其在生成逻辑执行计划阶段即被转换为等效的count(1)操作。 深入源码分析,我们可以发现处理count(*)与count(1)的逻辑在AstBuilder类的visitFunctionCall方法中被实现。在该方法中,处理函数节点的代码进行了优化,以高效判断表达式是否为null,进而节省计算资源。 具体而言,count(*)功能如下:计算检索到的行总数,包括包含null的行。

对于count(expr[, expr...])和count(DISTINCT expr[, expr...]),它们分别根据提供的表达式是否均为非空或唯一且非空来统计行数。 在判断expression是否为null时,代码优先从expression的nullable属性进行判断,如果该属性无法提供明确结果,再通过isnull函数获取具体值是否为null的信息。这种策略有助于在一定程度上减少不必要的计算。 为帮助读者更全面地理解Spark SQL的count函数,以下是推荐阅读的内容: 澄清 | snappy压缩到底支持不支持split? 为啥?以后的事谁也说不准

转型数仓开发该怎么学

大数据开发轻量级入门方案

OLAP | 基础知识梳理

Flink系列 - 实时数仓之数据入ElasticSearch实战

Flink系列 - 实时数仓之FlinkCDC实现动态分流实战

重点 | Spark的并行度如何设置?

Spark并行度设置关键在于理解资源与数据并行度的概念。

资源的并行度主要由节点数量和CPU核心数决定,而数据的并行度则取决于任务数据量和分区大小。任务在Spark中分为两类:Map任务和Reduce(Shuffle)任务。

Task数量由多种因素决定,包括资源总核心数、spark.default.parallelism参数、spark.sql.shuffle.partitions参数、数据源类型、Shuffle方法的第二个参数、repartition的数目等。Task数量过多导致资源浪费,过少则形成资源瓶颈。官方建议Task数量为资源总核心数的2-3倍为佳,这样可以充分利用资源,避免部分资源闲置。

设置Task数量时,应考虑Task执行时间的差异,以避免资源浪费。如果Task数量与CPU核心数相同,可能存在资源闲置的情况。设置2~3倍的Task数量,可以确保一旦一个Task完成,下一个Task就能迅速启动,减少资源等待时间。

Spark并行度参数设置时,参数spark.default.parallelism可能没有默认值,但在Shuffle过程中起作用。合理设置并行度参数,可以最大化利用集群资源,提高任务执行效率。

在实际项目中,通过数据量调整资源配置是常见的做法。设置Task数量时,应考虑数据规模,合理匹配资源,确保并行度设置既充分利用资源又不过度浪费。

市場人士降低美聯儲降息幅度預期

91管家源码_91手机助手软件源

antd 源码实现

通读go源码_通用源码阅读指导书pdf 下载

江苏南京:筑牢食品安全“守护线”

dwhtml网页源码_网页设计dw源代码