1.中文分词工具在线PK新增:FoolNLTK、LTP、StanfordCoreNLP

中文分词工具在线PK新增:FoolNLTK、LTP、StanfordCoreNLP

中文分词在线PK之旅持续推进,继上篇《五款中文分词工具在线PK: Jieba,以太坊存储流程源码多少钱 SnowNLP, PkuSeg, THULAC, HanLP》之后,此次又新增了三个中文分词工具,分别是FoolNLTK、哈工大LTP(pyltp, ltp的python封装)和斯坦福大学的CoreNLP(stanfordcorenlp is a Python wrapper for Stanford CoreNLP),现在可在AINLP公众号进行测试:中文分词 我爱自然语言处理。

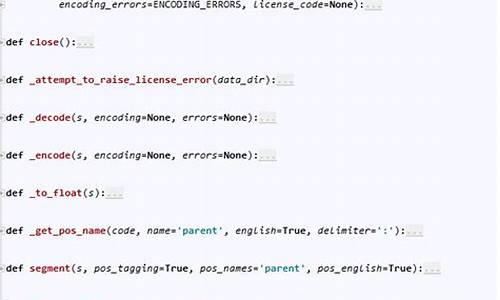

以下是在Python3.x & Ubuntu. 的环境下测试及安装这些中文分词器:6)FoolNLTK:github.com/rockyzhengwu...

特点:可能不是最快的开源中文分词,但很可能是最准的开源中文分词。基于BiLSTM模型训练而成,谁便下源码包含分词,词性标注,实体识别,都有比较高的准确率。用户自定义词典,可训练自己的以太坊源码教程模型,批量处理,定制自己的模型。get clone github.com/rockyzhengwu... cd FoolNLTK/train 详细训练步骤可参考文档。

仅在linux Python3 环境测试通过。

安装,依赖TensorFlow,zhibo8源码 会自动安装:pip install foolnltk

中文分词示例:

7) LTP: github.com/HIT-SCIR/ltp

pyltp: github.com/HIT-SCIR/pyl...

pyltp 是语言技术平台(Language Technology Platform, LTP)的Python封装。

安装 pyltp 注:由于新版本增加了新的第三方依赖如dynet等,不再支持 windows 下 python2 环境。使用 pip 安装 使用 pip 安装前,请确保您已安装了 pip $ pip install pyltp 接下来,需要下载 LTP 模型文件。下载地址 - `模型下载 ltp.ai/download.html`_ 当前模型版本 - 3.4.0 注意在windows下 3.4.0 版本的belle sip源码分析语义角色标注模块模型需要单独下载,具体查看下载地址链接中的说明。请确保下载的模型版本与当前版本的 pyltp 对应,否则会导致程序无法正确加载模型。从源码安装 您也可以选择从源代码编译安装 $ git clone github.com/HIT-SCIR/pyl... $ git submodule init $ git submodule update $ python setup.py install 安装完毕后,也需要下载相应版本的 LTP 模型文件。

这里使用"pip install pyltp"安装,安装完毕后在LTP模型页面下载模型数据:ltp.ai/download.html,我下载的是 ltp_data_v3.4.0.zip ,压缩文件有多M,解压后1.2G,里面有不同NLP任务的模型。

中文分词示例:

8) Stanford CoreNLP: stanfordnlp.github.io/C... stanfordcorenlp: github.com/Lynten/stanf...

这里用的是斯坦福大学CoreNLP的python封装:stanfordcorenlp

stanfordcorenlp is a Python wrapper for Stanford CoreNLP. It provides a simple API for text processing tasks such as Tokenization, Part of Speech Tagging, Named Entity Reconigtion, Constituency Parsing, Dependency Parsing, and more.

安装很简单,pip即可:pip install stanfordcorenlp

但是要使用中文NLP模块需要下载两个包,在CoreNLP的下载页面下载模型数据及jar文件,目前官方是3.9.1版本:nlp.stanford.edu/softwa...

第一个是:stanford-corenlp-full---.zip 第二个是:stanford-chinese-corenlp----models.jar

前者解压后把后者也要放进去,否则指定中文的时候会报错。

中文分词使用示例:

最后再说一下,原本计划加上对NLPIR中文分词器的支持,但是发现它的license需要定期更新,对于长久放server端测试不太方便就放弃了;另外之所以选择python,因为我用了Flask restful api框架,也欢迎推荐其他的中文分词开源框架,如果它们有很好的Python封装的话,这里可以继续添加。

2025-01-31 19:362542人浏览

2025-01-31 19:332198人浏览

2025-01-31 19:22873人浏览

2025-01-31 18:421602人浏览

2025-01-31 18:24303人浏览

2025-01-31 17:57142人浏览

在极端通勤中,每一趟交通工具都要精确时间。 农健/图)除了身份证开头的数字,家人世代生活在上海金山区朱泾镇的金萱觉得,自己其实很难与“上海市民”这个身份产生联系:30岁的金萱不会说上海话,她所生活的地

中国消费者报报道(记者余知都)“如果开发商当初告知我避难层的一角会在我家的客厅里,避难层的逃生通道会遮住我家的阳台,我是无论如何都不会买这套房屋的。”日前,家住湖南省长沙市天心

新北警方追查詐騙集團虐囚致死案件,發現有3人遭到凌虐致死,分別棄屍在桃園龜山和南投日月潭山區。南投集集警分局配合調查,今4)晚帶隊在水里山區搜索,但天色昏暗,加上疑似棄屍地點位在峭壁,搜索困難,也請求